Nvidia GTC 2026:Mencapai Pendapatan AI sebesar $1 Triliun

Nvidia GTC (atau Konferensi Teknologi GPU) telah menjadi salah satu konferensi AI terkemuka di dunia, yang terus berkembang setiap tahun sejak diluncurkan pada tahun 2009 seiring dengan pengaruh dan pendapatan perusahaan. Namun tahun ini menandai adanya pergeseran penekanan. Di masa lalu, perusahaan berfokus pada bagaimana mereka berekspansi ke pasar baru; tahun ini, perusahaan ini menunjukkan bagaimana mereka dapat berekspansi di pasar-pasar tersebut, terutama sebagai pemain kunci di bidang AI. Sebagai bukti nyata ambisi dan kesuksesan Nvidia saat ini, Nvidia meningkatkan proyeksi pendapatan AI sebesar $500 miliar pada tahun 2026 menjadi $1 triliun pada tahun 2027.

Secara khusus, CEO Jensen Huang menjawab meningkatnya kebutuhan dalam inferensi AI serta pesatnya pertumbuhan beban kerja agen dan bagaimana pertumbuhan tersebut dapat berdampak pada seluruh komputasi AI.

Visi Nvidia Untuk Full Stack:Kue 5 Lapis AII

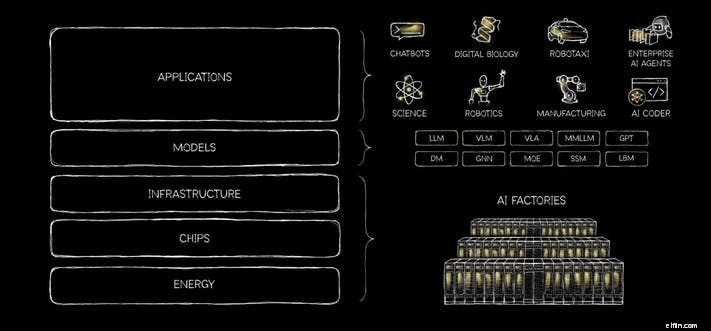

Sejak Desember 2025, Huang telah mempromosikan gagasan “kue lima lapis” AI. Konsep ini tampaknya merangkum keseluruhan strategi perusahaan untuk AI ketika mencoba mengomunikasikan sifat vertikal teknologi, yang jauh lebih kompleks daripada aplikasi atau model sederhana. AI digambarkan sebagai infrastruktur penting dengan berbagai lapisan mulai dari kebutuhan energi hingga aplikasi individual. Hal ini juga berupaya menyederhanakan kompleksitas tumpukan AI yang lengkap untuk kebanyakan orang.

Kue AI lima lapis Nvidia

Foto milik Nvidia

Inti dari tumpukan ini adalah energi, yang semakin menarik perhatian sebagai faktor pembatas berapa banyak komputasi yang dapat dibangun di lokasi tertentu. Pada gilirannya, chip yang menggunakan energi tersebut menentukan jumlah komputasi yang tersedia untuk memecahkan masalah AI. Berikutnya adalah infrastruktur yang mendukung chip tersebut dengan tanah, bangunan, penyaluran listrik, peralatan komputasi, pendingin dan jaringan. Infrastruktur ini memungkinkan model AI, yang bervariasi tergantung pada aplikasi dan kasus penggunaannya. Di tingkat atas, aplikasi itu sendiri memanfaatkan keluaran model untuk memberikan hasil bagi konsumen, pengguna bisnis, entitas pemerintah, dan sebagainya — yang menjadi dasar nilai ekonomi AI.

Huang mengatakan seluruh tumpukan komputasi harus diciptakan kembali untuk mendukung “pembangunan infrastruktur terbesar dalam sejarah manusia.” Nvidia menggunakan pesan ini untuk memposisikan dirinya tidak hanya sebagai pembuat chip, namun juga sebagai pendukung dasar semua komputasi karena semua komputasi kini beralih ke AI. CEO tersebut berbicara tentang pendekatan Nvidia yang menggabungkan “integrasi vertikal dan keterbukaan horizontal”, yang berarti bahwa modelnya terbuka untuk siapa saja, namun pendekatan komputasinya terintegrasi secara vertikal di setiap lapisan.

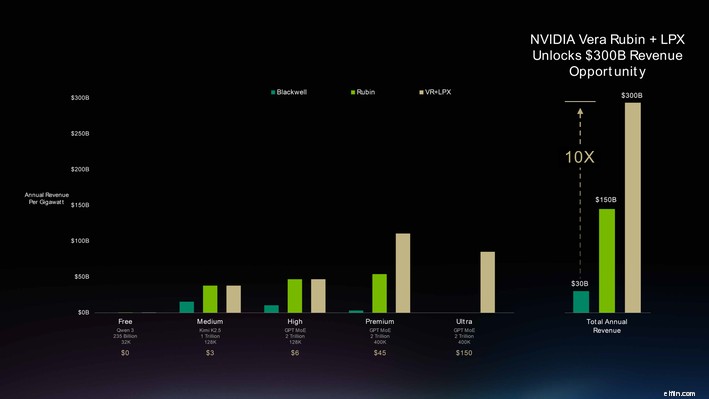

Vera Rubin Pod, LPX, dan Peluang Pendapatan 10x

Vera Rubin adalah platform komputasi kelas atas yang akan datang untuk Nvidia yang menggabungkan CPU Vera dan GPU Rubin; dijadwalkan untuk mulai dikirim beberapa bulan dari sekarang. Vera Rubin Pod adalah penawaran skala rak Nvidia yang menjanjikan peningkatan signifikan dalam kepadatan komputasi AI dalam pusat data. Ini menggabungkan tujuh jenis chip Nvidia di lima sistem rak berbeda untuk menciptakan konfigurasi berkinerja tinggi yang menurut perusahaan akan memungkinkan pembuatan token — dan pendapatan — hingga 10x lipat dibandingkan platform Blackwell generasi terakhir. Nvidia mengklaim bahwa hal ini dapat menghasilkan peluang inferensi tahunan sebesar $300 miliar.

Bagan yang menguraikan peluang inferensi arsitektur Nvidia

Foto milik Nvidia

Salah satu faktor pendukung terbesar dari Vera Rubin Pod adalah penggunaan platform LPX Groq, yang memanfaatkan chip Groq 3 LM30. Unit pemrosesan bahasa Groq secara inheren berbeda dari GPU Nvidia, dengan sejumlah besar SRAM (memori akses acak statis) dibandingkan dengan DRAM (memori akses acak dinamis). Karena meningkatkan bandwidth memori hingga 55x dibandingkan dengan GPU Rubin, LPU Groq secara inheren bagus dalam menangani tugas-tugas yang sangat membutuhkan memori. Hal ini membantu menjelaskan alasan Nvidia mengakuisisi kekayaan intelektual Groq dan talenta terpentingnya senilai $20 miliar pada bulan Desember 2025.

Berkembang Melampaui GPU:Fokus Perangkat Keras yang Beragam

Contoh Groq menunjukkan bagaimana Nvidia beralih dari upaya menjadikan GPU-nya sebagai solusi untuk setiap masalah. Meskipun ekosistem Nvidia telah lama berkembang melampaui GPU, perluasan tersebut hampir selalu ditujukan untuk GPU, baik melalui CPU, chip jaringan, atau perangkat lunak. Dengan diperkenalkannya LPU Groq 3, arsitektur komputasi Nvidia telah benar-benar melampaui pendekatan khusus GPU.

Kami juga melihat Nvidia mulai menawarkan produk seperti CPU berbasis Arm miliknya sendiri dalam solusi rak khusus CPU. Perusahaan memposisikan CPU Vera 88-core baru sebagai pesaing Intel dan AMD untuk pusat data. CPU ini dapat dikonfigurasi hingga 256 chip per rak, dan Nvidia sudah memiliki pelanggan termasuk Meta yang ingin menerapkannya. Selain CPU, Nvidia juga berbicara tentang solusi Bluefield 4 STX untuk aplikasi berorientasi penyimpanan; menurut perusahaan, produk ini meningkatkan kinerja untuk mencegah penyimpanan menjadi penghambat keluaran AI.

Produk Vera Rubin Lainnya:Pabrik dan Ruang AI Nvidia DSX 1

Nvidia DSX adalah platform terbaru berbasis Vera Rubin dari perusahaan untuk penawaran AI Factory-nya, yang mencakup desain referensi untuk pabrik AI dan memanfaatkan Omniverse Digital Twin dari Nvidia. (Untuk latar belakang Omniverse, lihat tulisan saya tentang GTC 2025 dan pandangan rinci rekan saya Bill Curtis tentang pergerakan Nvidia dalam AI fisik mulai Februari 2025.) Perusahaan menyebutnya sebagai solusi siap pakai yang memanfaatkan semua kemampuan yang telah diciptakan Nvidia dan mitranya untuk membantu merencanakan, membangun, dan memelihara pabrik AI. Platform ini dirancang untuk implementasi dengan hyperscaler dan perusahaan terbesar yang ingin menerapkan AI skala industri mereka sendiri tanpa harus membangun infrastruktur.

Akhir-akhir ini juga terdapat banyak desas-desus seputar komputasi AI di luar angkasa, dengan banyak startup yang diluncurkan untuk memecahkan masalah penerapannya. Sebelum pengumuman modul Space 1 berdasarkan Vera Rubin, Nvidia sebagian besar menggunakan chip Jetson Orin yang tertanam dan GPU H100 untuk aplikasi luar angkasa. Nvidia mengatakan bahwa modul baru yang berfokus pada ruang angkasa dirancang untuk aplikasi ekstrem ini dan memberikan kinerja AI di ruang angkasa sebanyak 25x dibandingkan H100. Ia juga dilengkapi pemrosesan langkah demi langkah dan kode koreksi kesalahan untuk memastikan bahwa pengoperasian di ruang angkasa tidak memengaruhi keluaran. Oleh karena itu, saya yakin Space 1 akan menjawab kebutuhan aplikasi khusus dan tidak boleh dilihat sebagai validasi kebutuhan pusat data di luar angkasa.

NemoClaw:Membangun Agen Khusus

Agentic AI dengan cepat menjadi area fokus yang penting karena agen seperti Claude Code membantu pengguna mengatasi tugas-tugas praktis. Dari sisi teknis, agen mengubah cara infrastruktur TI dibangun dan bagaimana chip di dalam infrastruktur tersebut dirancang. Salah satu perkembangan terbaru yang paling menarik adalah diperkenalkannya OpenClaw, agen sumber terbuka yang berjalan secara lokal menggunakan tumpukan NemoClaw sumber terbuka baru Nvidia untuk penerapan agen berorientasi tugas yang lebih aman.

Toolkit agen NemoClaw dirancang untuk membangun, melatih, dan menerapkan agen AI yang otonom dan aman, yang akan memudahkan siapa pun untuk membuat agen mereka sendiri. Dalam mengembangkan tumpukan baru, Nvidia bekerja sama dengan pencipta OpenClaw dan peneliti keamanan untuk membantu mencegah tindakan agen yang tidak diinginkan atau hasil yang berpotensi membahayakan.

DLSS 5.0:Penerapan Neural Rendering yang Kontroversial

Nvidia mengejutkan banyak orang, termasuk saya, dengan pengumuman DLSS 5.0, yang merupakan fitur opsional bantuan AI dari perusahaan untuk meningkatkan kualitas gambar dan menghasilkan rendering yang lebih cepat. Ia bekerja dengan merender pada resolusi yang lebih rendah dan kemudian menggunakan AI untuk meningkatkan gambar ke resolusi asli. Sebagian besar pengguna tampaknya senang dengan implementasi DLSS sebelumnya. Kini, DLSS 5.0 memperkenalkan teknik rendering saraf untuk lebih meningkatkan pencahayaan dalam pemandangan yang mungkin terlihat datar. Hal ini juga memberi pengembang game kontrol lebih besar terhadap pengalaman pengguna, dan mereka dapat menyesuaikan DLSS 5.0 untuk mengubah pengaruhnya terhadap visual game mereka.

Banyak orang bereaksi negatif terhadap foto dan video awal yang dibuat menggunakan DLSS 5.0. Menurut saya, ini adalah reaksi berlebihan yang signifikan. Ada banyak gamer yang membenci sebagian besar hal yang disempurnakan dengan AI, dan reaksi terhadap DLSS 5.0 mungkin merupakan puncak dari rasa frustrasi tersebut. Setelah melihat demonya secara langsung, saya dapat mengatakan bahwa hampir semua penyempurnaan tampak positif dan meningkatkan realisme — dan ini datang dari seorang fotografer serius yang sangat pilih-pilih dalam hal alat pengeditan. Selain itu, DLSS 5.0 masih jauh dari pengiriman, sehingga tidak jelas seperti apa produk akhirnya atau GPU mana yang dapat menjalankannya. Instansiasi saat ini berjalan pada dua kartu grafis Nvidia RTX 5090, namun menurut Nvidia, perangkat lunak tersebut akan dioptimalkan untuk berjalan pada satu GPU pada musim gugur.

Titik Perubahan Inferensi dan Proyeksi Pasar Huang senilai $1 Triliun

Dalam sambutannya di GTC, Huang berbicara tentang peluang pendapatan AI yang semakin meningkat bagi industri, dan menambahkan bahwa “Permintaan untuk GPU Nvidia sangat tinggi.” Dia mengklaim bahwa pertumbuhan inferensi mendorong peningkatan pendapatan secara signifikan sejak GTC edisi khusus diadakan di Washington, D.C., pada akhir tahun 2025 (yang saya tulis di sini).

Meskipun hal tersebut baru terjadi beberapa bulan yang lalu, perusahaan tersebut kini meningkatkan proyeksi peluang pendapatan sebesar $500 miliar pada tahun 2026 menjadi $1 triliun pada tahun 2027. Ini berarti bahwa Nvidia tidak hanya memperkirakan tahun ini akan berakhir dengan baik tetapi juga memperkirakan tahun 2027 akan menjadi lebih kuat lagi – ratusan miliar dolar lebih kuat. Dari sudut pandang saya sebagai seorang analis, masuk akal untuk berpikir bahwa transisi dari pelatihan AI ke inferensi AI yang luas dan AI agen yang tersebar luas akan menjadi pendorong yang signifikan bagi industri ini. Namun jika Huang benar, hal ini bisa menjadi katalisator pertumbuhan yang lebih besar — bagi Nvidia dan mitranya — dibandingkan yang dibayangkan sebelumnya.

Pengungkapan:Nvidia adalah klien penasihat perusahaan saya, Moor Insights &Strategy.

Strategi Bisnis

- Apa itu Transfer Risiko?

- 15 Side Hustles Terbaik yang Dapat Anda Hasilkan Pada Tahun 2022

- Apa itu Make To Order (MTO)?

- Apa itu Perusahaan Portofolio?

- Apa itu Tindakan Korporat?

- Cara Memilih Sertifikasi Bisnis Ramah Lingkungan (dan Memberitahu Mana Yang Sah)

- Pemenang Sejati di Beberapa Acara Penghargaan Adalah Promotornya

- Apa Keuntungan Penggerak Pertama?

-

Investasi di BigCommerce, Pelanggan Kami, dan Mitra Kami

Investasi di BigCommerce, Pelanggan Kami, dan Mitra Kami Hari ini BigCommerce mengumumkan bahwa Goldman Sachs telah memimpin pertumbuhan investasi ekuitas senilai $64 juta, dengan dukungan dari investor saat ini General Catalyst, GGV Capital, dan Tenaya Cap...

-

Memahami Dampak COVID-19 pada E-niaga dan Perilaku Belanja Online

Memahami Dampak COVID-19 pada E-niaga dan Perilaku Belanja Online Pada kuartal kedua tahun 2020, kehidupan kita seperti yang kita tahu telah berubah secara signifikan. Tapi bagaimana hal-hal berubah 18+ bulan? Penguncian yang begitu merajalela tahun lalu telah dic...